Mein Blog

- Details

- By Vincenzo Caserta

- Kategorie: Mein Blog

Haben Sie jemals einer künstlichen Intelligenz eine einfache Frage gestellt und eine offensichtlich unlogische Antwort erhalten? Das ist kein Fehler des Modells. Es ist ein Fehler des Prompts.

Ein banales, aber aufschlussreiches Experiment: ein LLM fragen, ob es besser ist, zu Fuß oder mit dem Auto zu einer 40 Meter entfernten Autowaschanlage zu gelangen. Ohne Kontext ist die Antwort falsch. Formuliert man dieselbe Frage mit einem geeigneten kognitiven Rahmen um, erkennt das Modell das Paradoxon, löst es und tut dies sogar mit einer Prise Sarkasmus.

Durch eine rigorose architektonische Analyse — Attention-Mechanismus, Wahrscheinlichkeitsverteilung über Token, Shortcut Reasoning — erklärt dieser Artikel, warum ein strukturierter Prompt radikal unterschiedliche Berechnungspfade aktiviert. Eine heute kritische Kompetenz für jeden, der ernsthaft mit Sprachmodellen arbeitet.

- Details

- By Vincenzo Caserta

- Kategorie: Mein Blog

Ein PHP-Dashboard, das rohe WAF-Logs in verwertbare Informationen verwandelt: Echtzeit-Risikobewertung, geografische Anreicherung und automatische IP-Sperrung über firewalld — ohne zusätzliche Infrastruktur.

- Details

- By Vincenzo Caserta

- Kategorie: Mein Blog

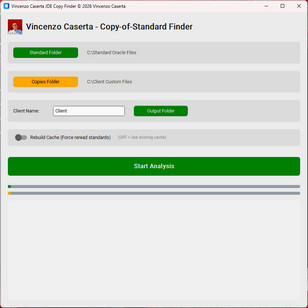

Jedes JD-Edwards-System mit einigen Jahren Laufzeit trägt eine unbeantwortete Frage in sich: Wie viele der im Laufe der Zeit entwickelten Custom-Objekte sind noch im Wesentlichen identisch mit dem Oracle-Standard, von dem sie abstammen – und wie viele haben sich so weit entwickelt, dass sie etwas völlig anderes geworden sind? Diese Frage wird dringend, wenn ein Upgrade, eine Migration oder ein Customizing-Audit ansteht. In den meisten Fällen gibt es keine Antwort, weil niemand sie jemals systematisch gesucht hat. In diesem Artikel beschreibe ich, wie ich dieses Problem in meiner Arbeit angehe, und das proprietäre Tool, das ich dafür entwickelt habe.

- Details

- By Vincenzo Caserta

- Kategorie: Mein Blog

Aktuelle Performance-Audits von dezentralen Edge Computing-Clustern zeigen, dass Liquid Neural Networks (LNNs) mittlerweile 92 % der Vorhersagegenauigkeit von großskaligen Transformers erreichen, während sie fast 400-mal weniger Parameter benötigen. Dieser Wandel markiert eine grundlegende Abkehr von der „Größer ist besser“-Philosophie, die die frühen 2020er Jahre dominierte, hin zu einem Paradigma mathematischer Eleganz und biologischer Mimikry.

Weitere Beiträge …

Seite 4 von 15