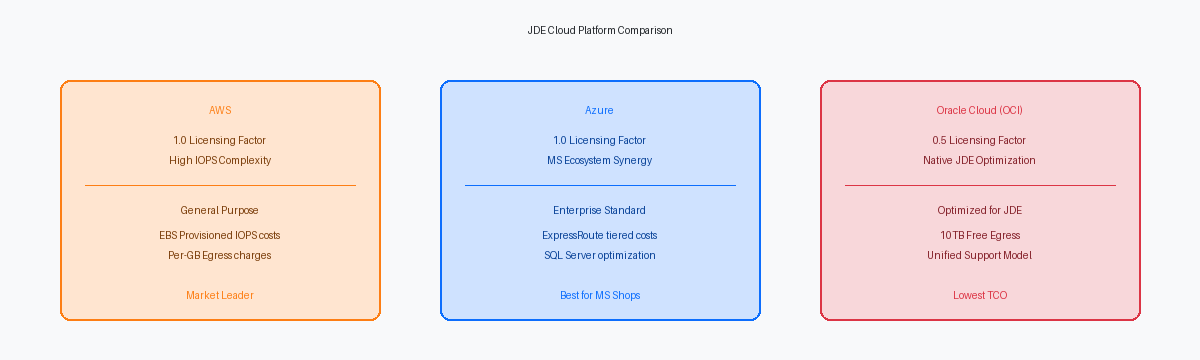

L'engagement d'Oracle pour le Premier Support de JDE 9.2 jusqu'en 2034 a déplacé la discussion sur le cloud d'une stratégie de sortie temporaire vers un enjeu d'infrastructure à long terme. La plupart des directeurs informatiques traitent JDE comme une charge de travail x86 générique, mais la comparaison des coûts entre JD Edwards sur AWS, Azure et Oracle Cloud est fondamentalement dictée par la « taxe Oracle » sur les licences de base de données. Dans un déploiement typique sur AWS ou Azure, vous vous retrouvez souvent à payer pour deux fois plus de vCPUs afin d'égaler les performances d'un seul OCPU sur OCI, en raison de politiques restrictives de facteur de cœur qui pénalisent le matériel non-Oracle.

Au-delà des licences, la dette technique d'une migration mal planifiée se manifeste dans les exigences d'E/S de l'Enterprise Server et la latence entre les niveaux AIS et base de données. Nous constatons systématiquement un surcoût d'environ un tiers lors de la première régularisation (true-up) pour les organisations qui effectuent un lift-and-shift vers des clouds tiers sans tenir compte des frais de sortie de données ou de l'absence de support natif pour Oracle RAC. Bien qu'Azure et AWS dominent le marché général, les exigences spécialisées de la pile JDE — spécifiquement les appels BSFN à haute fréquence et le traitement intensif des UBE — nécessitent un alignement architectural que les crédits cloud génériques ne peuvent fournir.

Licences Oracle Database et pénalité du facteur de cœur

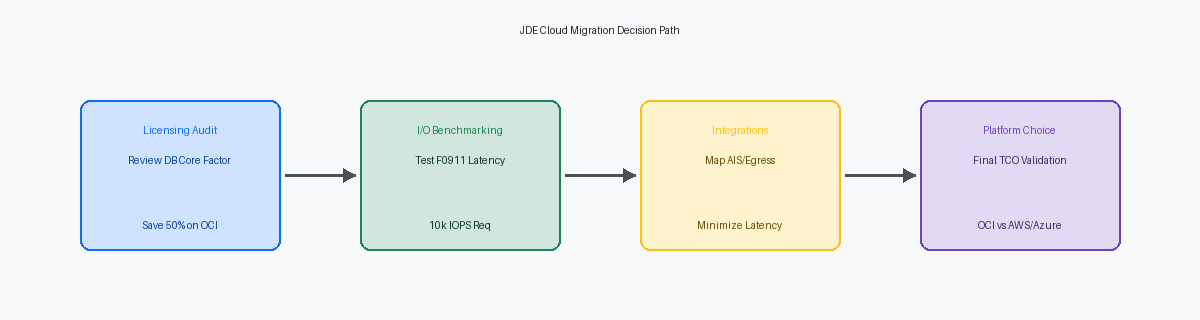

Le calcul des licences pour Oracle Database sur des clouds non-Oracle crée une pénalité de coût significative, doublant souvent les dépenses de licence, ce que de nombreux directeurs informatiques négligent lors de l'appel d'offres initial. Sur AWS EC2 ou les VMs Azure, Oracle impose un ratio de 1 pour 1 entre les vCPUs et les licences processeur. Si vous provisionnez une instance avec 16 vCPUs pour gérer une fenêtre de traitement batch UBE à haut volume, vous devez compter cela comme 16 licences. Sur OCI, le tableau Oracle Core Factor applique un multiplicateur de 0,5 aux instances x86. Cette même charge de travail de 16 vCPUs — équivalente à 8 OCPUs — ne nécessite que 8 licences. Cette divergence signifie que vos coûts annuels de support et de maintenance (S&S) pour le niveau base de données sont doublés dès que vous déplacez la charge de travail vers un hyperviseur non-Oracle.

De nombreux responsables ERP tentent de contourner cela en utilisant Standard Edition 2 (SE2), mais les limitations techniques sur AWS et Azure rendent souvent cela intenable pour la production. SE2 est strictement limité à 16 threads utilisateurs simultanés. Dans un environnement JDE avec plus de 400 utilisateurs actifs ou un trafic Orchestrator important basé sur AIS, cette limite de threads devient un goulot d'étranglement massif, entraînant des erreurs ORA-00020 et des délais d'attente applicatifs. Pour maintenir les temps de réponse inférieurs à la seconde que les utilisateurs attendent d'un environnement 9.2, vous êtes contraint de passer à l'Enterprise Edition (EE). Ce passage à l'EE sur un environnement avec un facteur de cœur de 1.0 peut multiplier par 3 ou 5 les dépenses totales en licences de base de données par rapport à un déploiement OCI correctement dimensionné.

L'exposition à la conformité lors d'un audit GLAS représente le risque caché le plus important pour les parcs JDE sur Azure. Oracle n'accorde pas le statut d'« Environnement Cloud Autorisé » à Azure pour certains composants middleware hérités ou des options de base de données spécifiques comme Active Data Guard. Si votre architecture JDE repose sur ces éléments pour la haute disponibilité, les auditeurs d'Oracle ne reconnaîtront pas les limites de CPU virtuels. Ils peuvent à la place calculer votre responsabilité sur la base du nombre total de cœurs physiques du cluster hôte sous-jacent. Ce manque de clarté contractuelle transforme une migration d'infrastructure standard en un piège potentiel de licences de plusieurs millions de dollars que le modèle de licence natif d'OCI évite.

Performances de l'infrastructure et IOPS pour les Enterprise Servers

Un environnement JDE lourd en traitements batch vit ou meurt par la latence des E/S disque, particulièrement lorsque le moteur UBE sollicite fortement les tables F0911 et F4211 lors de la clôture mensuelle ou du traitement des commandes de vente à haut volume. J'ai vu des jobs R42565 qui tournaient auparavant pendant plusieurs heures être réduits à moins d'une heure simplement en déplaçant la base de données vers un niveau garantissant une base de 10 000 IOPS. Dans un SAN sur site traditionnel, c'était une question de nombre de disques physiques ; dans le cloud, c'est une question de la manière dont le fournisseur limite votre débit et gère les pics de latence pendant les périodes de pointe.

Sur Oracle Cloud Infrastructure (OCI), les performances des Block Volumes sont prévisibles car Oracle ne sur-souscrit pas le matériel sous-jacent. Vous obtenez des performances constantes quel que soit le moment de la journée. L'exécution de JDE sur AWS EBS expose souvent au syndrome du « voisin bruyant » (noisy neighbor), où les pics de latence sur un plan de stockage partagé peuvent causer des échecs UBE aléatoires ou des temps de réponse interactifs lents dans le P4210. Bien que les volumes AWS io2 offrent une grande durabilité, le coût par IOPS provisionné pour égaler les niveaux de performance de base d'OCI peut augmenter votre poste de dépense stockage de 40 % ou plus.

Azure présente un défi différent pour les responsables ERP habitués aux performances du matériel haut de gamme. Atteindre les 10 000+ IOPS requis pour les environnements batch JDE à grande échelle sur Azure nécessite Premium SSD v2, ce qui ajoute des frais mensuels importants et nécessite une compatibilité spécifique avec les séries de VMs. Vous ne pouvez pas compter sur les niveaux SSD Premium standard ou anciens sans heurter un plafond de performance qui bride votre instance SQL Server ou Oracle DB. Si vous calculez mal cela pendant la phase de lift-and-shift, vous constaterez que votre environnement de production stagne lors du premier cycle batch à haut volume, forçant une mise à niveau d'urgence du niveau de stockage.

Coûts de connectivité cachés et frais de sortie de données

OCI offre les 10 premiers To de transfert de données sortantes gratuitement chaque mois. Dans un environnement d'intégration à haut volume où Orchestrator pousse des millions de charges utiles JSON vers des CRM externes ou des prestataires logistiques, c'est un écart de coût massif. AWS et Azure facturent la sortie de données dès le premier octet, généralement entre 0,05 $ et 0,09 $ par Go selon la région. Pour une entreprise générant un volume élevé (ex: 10-20 To) de trafic sortant mensuel, OCI ne facture que la portion au-dessus de 10 To, tandis qu'AWS et Azure facturent le montant total, créant une variance mensuelle à quatre chiffres sur une seule ligne de facture.

L'architecture d'un environnement split-cloud où le niveau web se trouve sur Azure et la base de données sur OCI introduit une pénalité de latence qui dégrade les performances de JDE. Une transaction EnterpriseOne standard implique des dizaines, voire des centaines d'appels SQL entre l'Enterprise Server et la base de données. Ajouter 2 ms à 5 ms de latence aller-retour par appel entraîne un « gel » perceptible pour les utilisateurs dans des applications comme P4210 ou P4310. Bien qu'un délai de 5 ms semble négligeable pour un ingénieur réseau, il se traduit par des secondes de décalage lorsqu'une seule interconnexion de formulaire déclenche une cascade d'appels BSFN et de lectures de base de données.

La tarification prévisible de la connectivité est l'endroit où le modèle FastConnect à 1 Gbps surpasse la complexité par paliers d'Azure ExpressRoute. Le modèle d'Azure implique souvent des plans de données facturés à l'usage ou des niveaux « Illimités » coûteux qui s'adaptent mal à mesure que les besoins en bande passante augmentent. La tarification au port forfaitaire d'OCI pour FastConnect permet un budget mensuel constant, quel que soit le nombre d'UBEs envoyant de gros fichiers PDF vers des serveurs d'impression sur site. Les DSI déplaçant quotidiennement 500 Go de données de rapports vers des sites locaux constatent que le coût cumulé des paliers ExpressRoute peut dépasser les frais de port forfaitaires d'OCI de près de moitié dès la première année d'exploitation.

Coût total de possession et maintenance à long terme

Le déplacement d'une charge de travail de production JDE vers le cloud concerne rarement le prix affiché de la première année ; le véritable écart apparaît dans le TCO sur trois à cinq ans. D'après mon expérience d'audit de migrations multi-plateformes, le coût total de possession sur OCI est généralement inférieur de 25 % à 40 % à celui d'AWS ou d'Azure sur cet horizon de cinq ans. Cet écart résulte de la tarification d'Oracle pour le transfert de données sortantes et de l'élimination de la « taxe Oracle » sur les hyperviseurs non-Oracle. Lorsque vous intégrez la feuille de route de support jusqu'en 2034 pour la 9.2, une économie d'environ un tiers à près de la moitié se traduit par un capital significatif pour une entreprise exploitant 15 à 20 serveurs.

La main-d'œuvre de maintenance représente le coût invisible le plus important de tout déploiement cloud. L'utilisation du OS Management Service d'OCI permet aux équipes CNC de réduire de plus de moitié les heures de travail manuel pour les mises à jour du noyau Linux et les correctifs de sécurité. Au lieu de se connecter à chaque serveur Logic et Batch pour gérer les dépendances, la plateforme gère l'orchestration des correctifs à l'échelle du parc. Cette automatisation évite les scénarios où une mise à niveau de Tools Release 9.2.8 est retardée parce que l'OS sous-jacent a plusieurs versions de retard sur les correctifs de sécurité.

Les devis budgétaires d'AWS manquent souvent de la réalité granulaire des exigences architecturales de JDE. Des coûts cachés font fréquemment surface sous la forme de frais de passerelle NAT pour le trafic sortant et de la nécessité d'IOPS provisionnés (volumes io2) pour maintenir des performances UBE acceptables. Un environnement JDE typique avec une base de données de 2 To et un traitement batch à haute concurrence peut facilement doubler ses coûts de stockage une fois que vous réalisez que les SSD « General Purpose » (gp3) ne peuvent pas gérer les E/S aléatoires soutenues requises pour les lancements de GL post ou de MRP à grande échelle.

La maintenance à long terme dépend également du cycle de vie du niveau base de données. Sur Azure ou AWS, vous gérez souvent des solutions de contournement de licence complexes ou payez un supplément pour des options RDS qui peuvent ne pas supporter pleinement les exigences spécifiques à JDE, comme certains déclencheurs XAPI. L'intégration native d'OCI avec le Database Cloud Service (DBCS) offre un chemin de correction simplifié qui garantit que les couches base de données et application restent synchronisées sans la friction multi-fournisseurs qui pèse généralement sur les sessions de dépannage de performance.

Certification du support et écart multi-fournisseurs

La politique de support d'Oracle pour les clouds non-Oracle est un risque calculé pour tout DSI. Bien que JDE soit techniquement supporté sur AWS et Azure, la matrice des Minimum Technical Requirements (MTR) s'accompagne d'une mise en garde importante. Si votre équipe ouvre un SR de niveau 1 pour une fuite de mémoire ou un plantage du noyau qu'Oracle soupçonne d'être ancré dans l'hyperviseur ou la couche de stockage sous-jacente, ils se réservent le droit de vous demander de reproduire ce problème exact sur une infrastructure Oracle certifiée ou sur du matériel sur site avant de s'engager sur un correctif. Cette exigence peut ajouter 48 à 72 heures d'indisponibilité à un problème critique pendant que votre équipe CNC s'empresse de provisionner un bac à sable local pour la reproduction.

Cet écart multi-fournisseurs crée un point de friction dangereux lors des pannes critiques. Dans un scénario où un Enterprise Server ne répond plus sous une lourde charge UBE, un client AWS ou Azure se retrouve souvent à arbitrer un différend entre deux services de support. Le support Oracle pointe du doigt la limitation des E/S du fournisseur cloud, tandis que le fournisseur cloud pointe les modèles d'exécution BSFN. Passer à OCI déplace cette dynamique vers un modèle à responsabilité unique. Lorsque l'éditeur de l'ERP et le fournisseur cloud sont la même entité, l'avantage d'un support unifié réduit le temps moyen de résolution en éliminant les jours d'échanges de fichiers journaux entre des organisations de support disparates.

Le maintien de la conformité MTR sur OCI est un processus simplifié par rapport à la charge manuelle de suivi des mises à jour des clouds tiers. Oracle aligne ses cycles de JDE Tools Release, comme la transition de 9.2.7 à 9.2.8, avec les formes de calcul et les versions de base de données spécifiques disponibles sur OCI. Sur Azure ou AWS, une dépréciation soudaine d'une version d'OS ou un changement dans le moteur RDS sous-jacent peut techniquement rendre votre environnement non conforme. Sur OCI, ces feuilles de route d'infrastructure sont synchronisées, garantissant qu'un correctif appliqué au serveur AIS ou une nouvelle fonctionnalité d'Orchestrator n'entre pas en conflit avec une mise à jour de plateforme non certifiée.

Orchestrator et automatisation dans l'environnement Cloud

La latence est le tueur silencieux des déploiements complexes d'Orchestrator. Lorsqu'un serveur AIS déclenche une série de Data Requests ou de Form Services, le temps aller-retour entre le niveau web et le niveau base de données dicte l'expérience utilisateur. Placer ces composants sur le même réseau haute vitesse — standard dans les clusters connectés par RDMA d'OCI — réduit la latence à des niveaux inférieurs à la milliseconde. Les architectures multi-cloud ou hybrides introduisent souvent 5 à 10 ms de retard par appel. Pour une orchestration en plusieurs étapes traitant 50 enregistrements, cette latence ajoute 250 à 500 ms de surcharge, ce qui fait la différence entre une opération de scan mobile fluide et un système qui semble lent pour les opérateurs en entrepôt.

Le déploiement de JD Edwards sur Autonomous Database déplace la charge opérationnelle loin de la maintenance manuelle. Les environnements traditionnels exigent qu'un DBA passe 20 à 30 heures par mois sur l'optimisation des index, la collecte de statistiques et l'application de correctifs. Le moteur Autonomous automatise ces tâches, garantissant que la base de données est toujours optimisée pour les modèles d'IOPS spécifiques aux charges de travail interactives et UBE lourdes de JDE. Cette automatisation élimine la nécessité d'un DBA dédié spécifiquement à JDE, permettant à votre équipe technique de se concentrer sur le développement de Logic Extensions qui apportent une réelle logique métier plutôt que de simplement gérer la croissance des tablespaces.

Le passage à JDE 64 bits est la base non négociable pour toute entreprise visant la Tools Release 9.2.8 ou les dernières mises à jour applicatives. Alors que les environnements AWS et Azure nécessitent une approche manuelle pour re-platformer les fonctions métier en code C, OCI offre le chemin le plus simplifié via des utilitaires de migration automatisés. La transition vers une architecture 64 bits supprime la limite de mémoire de 4 Go par processus, ce qui se traduit généralement par un gain de performance de 15 à 20 % pour les UBE gourmands en mémoire comme le R09801 General Ledger Post. En fin de compte, le choix entre AWS, Azure ou OCI pour un environnement EnterpriseOne 9.2 repose sur les licences de base de données et le débit AIS plutôt que sur le simple prix des VMs ; pour la plupart des organisations, l'alignement architectural d'OCI se traduit par un modèle de support plus stable et un TCO à long terme plus bas.