Mon blog

- Détails

- By Vincenzo Caserta

- Catégorie : Mon blog

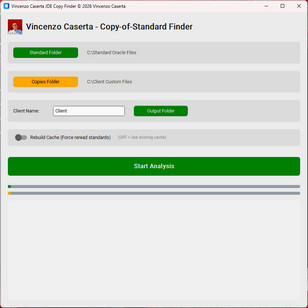

Tout système JD Edwards ayant quelques années d'existence porte en lui une question sans réponse facile : combien des objets personnalisés développés au fil du temps sont encore fondamentalement identiques au standard Oracle dont ils sont issus, et combien ont évolué au point de devenir quelque chose de complètement différent ? Cette question devient urgente lors d'un upgrade, d'une migration ou d'un audit des personnalisations. Dans la plupart des cas, la réponse n'existe pas — parce que personne ne l'a jamais cherchée de façon systématique. Dans cet article, je décris comment j'aborde ce problème dans mon travail, et l'outil propriétaire que j'ai développé pour le résoudre.

- Détails

- By Vincenzo Caserta

- Catégorie : Mon blog

Les récents audits de performance des clusters de edge computing décentralisés indiquent que les Liquid Neural Networks (LNN) atteignent désormais 92 % de la précision prédictive des Transformers à grande échelle, tout en utilisant près de 400 fois moins de paramètres. Ce changement représente une rupture fondamentale avec la philosophie du « plus c'est gros, mieux c'est » qui a dominé le début des années 2020, pour s'orienter vers un paradigme d'élégance mathématique et de mimétisme biologique.

- Détails

- By Vincenzo Caserta

- Catégorie : Mon blog

Un essaim de micro-drones survole une zone de reboisement en Amazonie, décidant de manière indépendante — grâce à la vision par ordinateur et à des capteurs hyperspectraux — quelles jeunes pousses ont besoin d'une irrigation immédiate et quelles zones nécessitent une intervention contre les parasites, le tout sans un seul opérateur humain à des kilomètres de là. Ce scénario n'est plus une promesse de science-fiction, mais la réalité quotidienne de 2026, où le concept d'« autonome » a transcendé la simple automatisation programmée pour devenir une intelligence décisionnelle en temps réel.

- Détails

- By Vincenzo Caserta

- Catégorie : Mon blog

Le Chaos des Microsecondes

Imaginez une épaisse couverture nuageuse se déplaçant de manière inattendue au-dessus d'un quartier, tandis que des centaines de véhicules électriques lancent simultanément leur recharge rapide. À ce moment précis, la production locale d'énergie photovoltaïque s'effondre, tandis que la courbe de charge monte en flèche. Un opérateur humain dans un centre de contrôle n'aurait aucune chance de réagir à ces fluctuations en quelques millisecondes. Par le passé, ces effets en cascade provoquaient des pannes locales ou nécessitaient des capacités tampons massives et coûteuses, souvent inutilisées. Le problème n'est pas le manque d'énergie, mais l'incapacité des systèmes classiques centralisés à coordonner la complexité explosive de millions de points d'accès décentralisés.

Plus d'articles...

Page 4 sur 14